Mundo

IA falha em identificar deepfakes de Nicolás Maduro

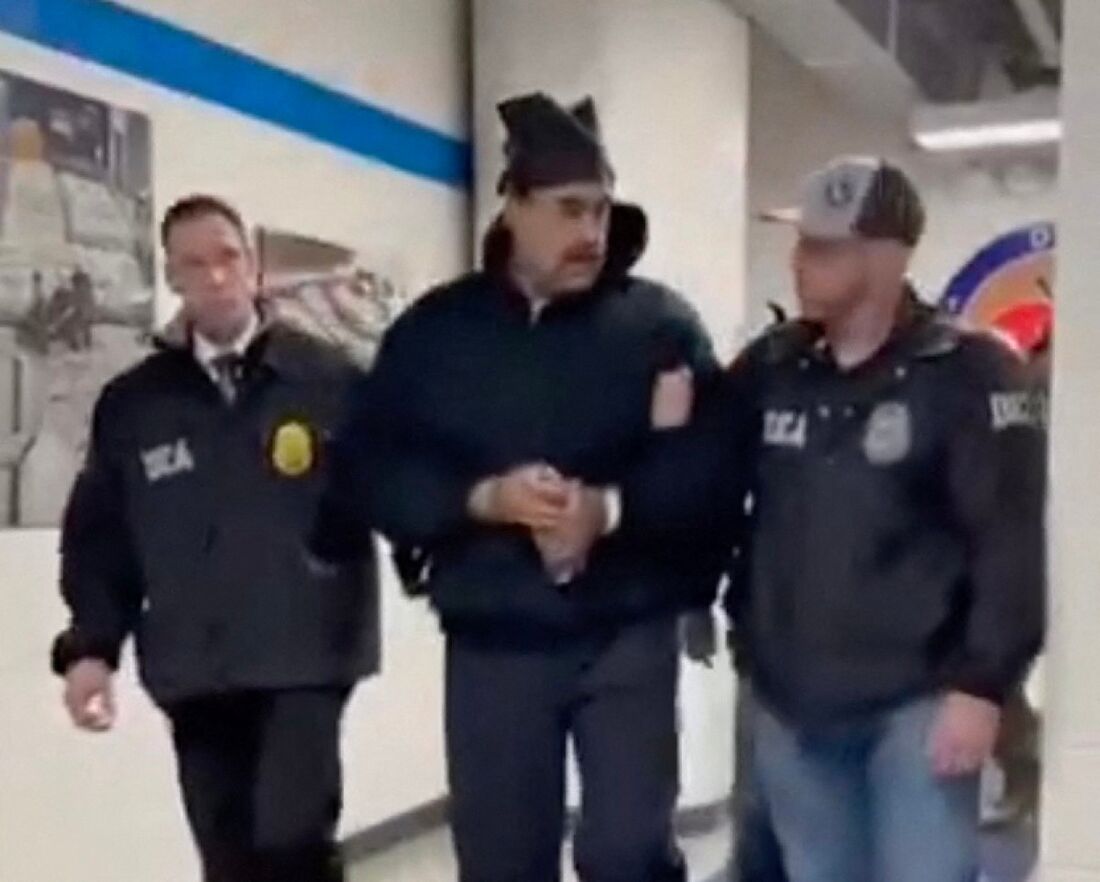

Poucas horas após a captura de Nicolás Maduro, o ex-presidente da Venezuela deposto, pelas forças dos EUA, as redes sociais foram invadidas por imagens que o mostravam algemado, escoltado por agentes antidrogas ou cercado por militares em uma aeronave. Essas imagens eram falsas, geradas provavelmente por ferramentas de inteligência artificial (IA), em um dos primeiros casos em que imagens criadas por IA mostraram figuras públicas durante um evento histórico emergente.

A maioria dos principais geradores de imagens por IA possui restrições quanto à criação de conteúdos enganosos ou falsos, proibindo explicitamente imagens falsas de personalidades públicas como Maduro. Apesar disso, várias dessas ferramentas aceitaram, em testes realizados pelo The New York Times, criar imagens falsas similares às que circularam após a notícia da prisão, muitas vezes de forma rápida e gratuita.

O potencial de confusão e manipulação gerado por essas falsificações sempre foi uma preocupação desde a popularização das ferramentas de IA, e a tecnologia evoluiu o suficiente para transformar essa ameaça em realidade.

Jeanfreddy Gutiérrez, responsável por uma operação de verificação de fatos em Caracas e baseado na Colômbia, percebeu a circulação desses deepfakes no dia da prisão de Maduro. Algumas imagens foram inicialmente divulgadas pela mídia latino-americana e depois substituídas por fotografias oficiais compartilhadas pelo então presidente Donald Trump. Gutiérrez publicou uma verificação identificando várias imagens deepfake, incluindo uma possivelmente criada pelo aplicativo Gemini da Google.

A empresa NewsGuard, que monitora a confiabilidade das informações online, rastreou cinco imagens fabricadas ou descontextualizadas e dois vídeos alterados relacionados à prisão de Maduro. Juntos, esses conteúdos tiveram mais de 14,1 milhões de visualizações na plataforma social X em apenas dois dias, além de terem circulado também em plataformas da Meta como Instagram e Facebook, porém com menor engajamento.

Após o evento, o Times testou dezenas de geradores de imagens por IA para verificar quais seriam capazes de criar imagens falsas do ex-presidente venezuelano.

Grande parte das ferramentas, incluindo o Gemini, modelos da OpenAI e da X, geraram as imagens solicitadas rapidamente, desafiando as garantias das empresas de tecnologia sobre salvaguardas para impedir o uso indevido.

O Google, por exemplo, possui políticas que proíbem a criação de desinformação e impedem conteúdos enganosos relacionados a processos governamentais. Um porta-voz da empresa explicou que não proíbem categoricamente imagens falsas de figuras públicas e que uma das imagens falsas de Maduro criada nos testes não violou essas políticas. Além disso, o Google implementou uma marca d’água oculta chamada SynthID no Gemini, para identificar imagens criadas por sua IA.

A ferramenta ChatGPT da OpenAI afirmou não poder criar imagens de Maduro, contudo, um site que utiliza o mesmo modelo produziu as imagens solicitadas. Um representante da OpenAI explicou que as salvaguardas existem para proteger figuras públicas, focando especialmente na prevenção de deepfakes sexuais ou violentos.

O Grok, modelo de IA da X.ai, gerou imediatamente imagens realistas da prisão. Apesar do Grok estar sob intenso escrutínio por ter respondido a pedidos inadequados anteriormente, a empresa afirmou estar corrigindo as falhas nas salvaguardas.

Outras ferramentas, como o chatbot Meta AI do Facebook e o Flux.ai, geraram imagens de um homem com bigode sendo preso, porém sem representarem fielmente Maduro. Quando solicitado imagens mais realistas, o chatbot da Meta negou a criação.

Segundo Mariví Marín, diretora da ProboxVE, uma organização que estuda o ambiente digital na América Latina, os deepfakes de Maduro surgiram como uma resposta coletiva à necessidade de preencher visualmente um momento urgente, refletindo diferentes percepções dos venezuelanos sobre o evento em questão.

Desconfiança e o desafio da verdade

Venezuela é um dos países com maior restrição à liberdade de imprensa, o que dificulta o acesso a informações confiáveis. Nesse contexto, o impacto dos deepfakes agrava ainda mais a desconfiança pública.

Jeanfreddy Gutiérrez observa que muitas pessoas ficaram céticas quanto à imagem de Maduro compartilhada por Trump, ressaltando o fenômeno paradoxal de duvidar da verdade e acreditar em mentiras.

Verificadores de fatos na América Latina já estavam preparados para esse tipo de deepfake devido a casos anteriores envolvendo figuras como Donald Trump e Joe Biden. Desde a pandemia, grupos de checagem vêm colaborando para combater rumores e teorias da conspiração relacionadas a eventos internacionais e eleições.

Gutiérrez conclui: “É um trabalho árduo, e infelizmente frequentemente perdemos a batalha para convencer as pessoas da verdade”.

Você precisa estar logado para postar um comentário Login